训练时代靠工厂,推理时代靠网格

过去两年,AI 基础设施的叙事几乎只有一个方向:把更多 GPU 堆进更大的数据中心,把 H100、Blackwell 这样的芯片编织成一座座吞吐量惊人的“AI 工厂”。这套逻辑在模型训练时代几乎无往不利——谁能把集群建得更大,谁就更接近下一代基础模型的门票。

但当 AI 从“训练竞赛”走向“推理落地”,问题开始变了。

因为今天真正决定 AI 能不能进入现实世界的,已经不再只是总算力,而是延迟。当一个模型要实时理解视频流、驱动机器人动作、完成一次金融登录背后的毫秒级风控判断时,哪怕是一次跨区域的数据往返,都会把“聪明”变成“来不及”。

这也是为什么, NVIDIA AI Grid 的推出是一个令人激动的全新事物。

3 月 18 日,Akamai 宣布发布首个全球规模的 NVIDIA AI Grid 参考设计实施方案。按照官方说法,这套方案通过把 NVIDIA AI 基础设施集成进 Akamai 的架构,并结合网络层面的智能工作负载编排,试图推动行业从孤立的“AI 工厂”,走向一个统一、分布式的AI 推理网格。

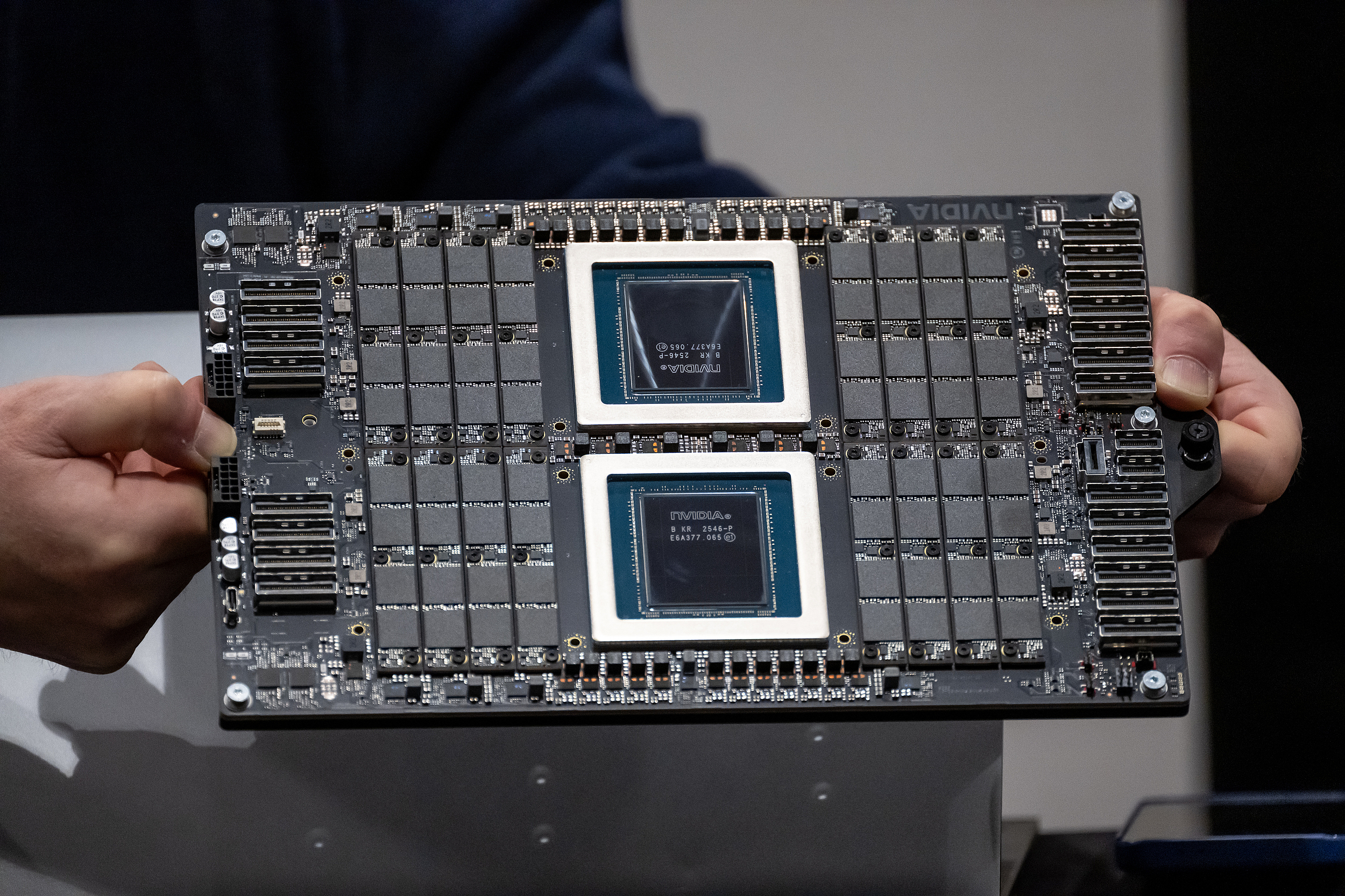

Akamai 成为首家把 AI Grid 运营化 的公司:在全球范围内部署数千个基于 NVIDIA RTX PRO 6000 Blackwell 服务器版 GPU 的平台,让企业既能获得接近本地计算的响应速度,又能保留全球网络级别的规模优势。

Akamai 云技术事业部首席运营官兼总经理 Adam Karon 对这个判断说得很直白:AI 工厂仍然最适合训练和前沿模型负载,因为中心化基础设施在这些场景下拥有最好的“Token 经济”;但当场景变成实时视频、物理 AI 和高并发个性化体验时,推理必须发生在接触点,而不能总是往返中心化集群。Akamai 想做的,就是把原本改变内容分发的分布式架构,再复制到 AI 推理这件事上。

“AI 工厂”的瓶颈,与“推理网格”的诞生

“AI 工厂”和“AI Grid”之间的根本区别在于前者解决的是训练时代的集中式算力生产问题。它强调的是超大规模 GPU 集群、原始吞吐量和模型迭代效率。

后者解决的则是推理时代的分布式交付问题。它关心的不是“某个模型能不能在一个超级集群里跑起来”,而是“这个模型能不能在需要它的那个瞬间,足够快地出现在用户、设备和场景面前”。

从这个角度看,Akamai 这次并不是简单地“把 GPU 部署到了边缘”,而是在试图定义一种新的 AI 基础设施组织方式:让中心化 AI 工厂继续负责最重的训练、后训练和多模态推理,让分布式网络承担更接近现实触点的推理执行,二者通过智能编排连接起来。

这也是为什么它把这个体系称作 AI 推理网格。它是一个从远端边缘到核心公有云、再到专用 GPU 集群的计算连续体。

在最外层的边缘侧,4,400 多个站点负责承接那些对响应速度最敏感的任务,比如物理 AI、自主智能体和实时互动场景。这里不仅有语义缓存,还有 Akamai Functions、EdgeWorkers 这类基于 WebAssembly 的服务端能力,用来保证模型亲和性和性能稳定性。

在更靠内的核心层,Akamai Cloud IaaS 和专用 GPU 集群则承担更重的负载,包括大规模迁移、成本优化,以及大型语言模型、持续后训练、多模态推理这类持续高密度计算任务。

换句话说,Akamai 并不是在否定 AI 工厂,而是在给 AI 工厂加一个“外延系统”——把原本只能在中心完成的推理能力,以网络和调度的方式向外扩展。

这也是 NVIDIA 电信业务发展全球副总裁 Chris Penrose 所强调的重点:新一代 AI 原生应用需要的是全球范围内可预测的延迟和更高的成本效率。把 NVIDIA AI Grid 运营化,意味着智能可以更直接地被送到数据所在的位置,而不是等待数据回流到某个远方的数据中心。

“Token 经济学”变了:AI 不只是会算,还得算得值

这次公告里一个很值得注意的关键词是 “Token 经济”(tokenomics)。

在大模型语境里,Token 一直是最核心的度量单位之一。每生成一个 Token,背后都对应着推理开销、时间成本和资源占用。训练时代,大家主要关心“单位成本下能堆出多大的模型”;而到了推理时代,更现实的问题变成:每一个 Token 到底值多少钱、来得够不够快、系统能不能承载足够多的请求。

Akamai 给出的答案,是一个位于系统中间层的智能编排器。

这个编排器可以理解成 AI 请求的“实时代理”。它的价值不在于替代模型,而在于为模型请求找到当下最合适的落点。它会结合工作负载感知、语义缓存和智能路由,把不同请求发送到不同层级的资源上:简单任务不必占用高端 GPU,复杂的多模态任务则交给核心节点上的重型资源处理。

这背后其实是一套很典型的“物流系统”思路:

不是所有货都要走同一条最贵的快线,也不是所有请求都值得动用最昂贵的 GPU 周期。只有当请求、模型和算力层级被更精细地匹配时,推理的单位成本才会真正下降。

Akamai 的优势之一,是它原本就拥有一个覆盖全球 4,400 多个站点的分布式网络。如今这张网络被重新用来承接 AI 推理的分发和调度逻辑:通过在靠近用户触点的位置处理请求,系统可以绕过中心云往返带来的时间损耗,缩短首个 Token 时间,同时提升整体吞吐表现。

在这个意义上,Akamai 想优化的,不只是模型推理本身,而是AI 作为一种服务被交付的效率。

谁最需要这张网格?

从应用场景来看,Akamai 这套架构瞄准的是一类共同特征非常鲜明的业务:它们既要 AI,又等不起。

游戏是最容易理解的例子。如果一个 AI 驱动的 NPC 需要依赖远端集群才能响应,那体验会立刻破功。Akamai 提到,游戏工作室已经在部署亚 50 毫秒级推理,用于 AI NPC 和实时玩家交互。

金融服务是另一种典型场景。在用户点击登录到首屏刷新的那一瞬间,系统需要同时完成欺诈检测、推荐和个性化决策。如果推理不能在极短时间内完成,体验和风控都会受损。

媒体和视频行业同样如此。全球实时转码、AI 配音,本质上都是对吞吐、时延和稳定性同时敏感的任务。零售和商业场景也一样:门店内的 AI 应用、销售点生产力工具,并不适合在每个门店都单独堆一套重型服务器,更合理的方式是接入一个分布式推理网络。

这也是为什么 Akamai 特别强调它已经拿到了一份为期四年、价值 2 亿美元的服务协议,用于在城市边缘企业 AI 基础设施的数据中心内部署数千个 GPU 集群。它说明至少在一部分企业客户眼里,这不再只是一个“技术概念验证”,而是已经具备基础设施采购意义的方案。

AI 基础设施正在从“工厂逻辑”转向“电网逻辑”

如果把这次发布放到更大的产业脉络里看,它最值得关注的地方,不只是 Akamai 新上了多少 GPU,而是 AI 基础设施的组织逻辑正在发生变化。

第一波 AI 基础设施,确实是由中心化的大型集群定义的。它们像工厂一样高密度、封闭、昂贵,目标是把训练效率推到极致。

但当推理逐渐成为主导负载、企业开始真正部署 AI 代理时,行业会发现,很多问题已经不再是“工厂逻辑”能单独解决的。

媒体交付、在线游戏、金融交易,互联网历史上都经历过类似阶段:最初大家以为只要把中心节点做得足够强大就够了,后来才发现,真正支撑规模化体验的,是分布式网络、智能编排和贴近触点的计算能力。

这正是英伟达近一段时间反复强调的方向:AI 的未来不只是更大的训练集群,也不只是更强的单点算力,而是一套从核心到边缘、面向实时世界的计算体系。

Akamai 这次扮演的,更像是一个产业落地样本。它的意义不在于单独证明某一家公司的技术能力有多强,而在于说明:当推理、智能体和物理 AI 真的开始进入生产环境时,英伟达所描绘的那种分布式、网络化、贴近现实触点的 AI 基础设施,正在从判断变成现实。

从这个意义上说,被验证的不是一家公司的故事,而是一个行业方向:AI 基础设施的下一阶段,可能真的不再只属于“工厂”,而属于“网格”。