这家两个月达成千万美金 ARR 的团队,认为音乐才是 AI 视频的入口。

整理 | 曹思颀

采访 | 张鹏、曹思颀

2026 年,在以 OpenClaw 为代表的 Agentic AI 成为整个 AI 圈「超级共识」的同时,视频模型却开始走向另一种分化。

在美国,OpenAI 已关闭 Sora 的独立产品形态,视频生成在其当前优先级里明显后撤;Runway、Luma AI 等创业公司也开始把叙事的中心转向「世界模型」。

而国内则呈现另一番景象:视频模型正在成为大厂下一阶段必争的多模态能力。无论是字节旗下的即梦,还是快手旗下的可灵,这类视频生成产品正在从大众娱乐场景,进一步渗透进付费意愿更强的专业创作者群体。

Sand.ai 是这轮分化里一个值得观察的创业样本。他们的核心产品 VidMuse 主打「Music in,Video Out」的产品形态,把音频放到产品最核心的输入位置。据了解,VidMuse 自年初上线以来,ARR(年度经常性收入)已超千万美金。

近期,Sand.ai 宣布完成了新一轮约 5000 万美元的融资,极客公园也和 Sand.ai 创始人曹越、VidMuse 产品负责人张子贺Zake 进行了当面沟通。在 Sand.ai 看来,音乐的重要性并不因为它对应某一类内容或用户,而在于它可能成为 AI 时代视频创作更底层的输入起点,也天然连接着更强的创作意愿。

与此同时,Sand.ai 还坚定地选择了既做产品又做模型的「双轮驱动」路径:先用市场上效果最好的模型为产品找到 PMF,再用自家的模型回到关键节点换效果、换成本、换毛利。无论从精力、能力还是资源上看,这都不是一条轻松的路。但在曹越看来,这恰恰是创业公司相对巨头的一种优势:在这里,模型和产品更容易服务于同一个目标,而不会彼此分裂。

而这条路径真正指向的,不只是一个更强的视频生成工具,而是一个能够长期协作的「数字制片团队」。在 Video Agent 这种新的产品形态下,用户更像一个「出资方」:不再需要充当导演反复 prompt 奖戏,而是可以把创作目标安心托付给一个能够长期信赖、持续调用的创作伙伴。

以下是整理后的访谈内容:

Part.1:视频模型生成的「中美分野」

极客公园:你们关注到最近很火那个 HappyHorse 了吗?

曹越:看到了,还挺有意思的,好多人拿推特上一个分析的帖子来问这个是不是我们的模型。我后来发现,是有个网站上面就直接把我们 Magihuman tech report(Sand.ai 最新开源的模型)内容转成网页,名字是 HappyHorse。(笑)不过我们的新模型在训练中,会尽快推出,很大概率会直接开源出来,希望整个行业一起加速推动。

极客公园:所以是个 fake news。但最近你们一边内测新产品 VidMuse 2.0,一边开源了一个基模,在外部看来是个有点反共识的决定。今天大家都在强调商业化和闭源,你们为什么选择开源?

曹越:我觉得开源的本质之一是提升品牌价值,有的时候也能够降低获客成本。比如 DeepSeek-R1 那次开源,大家一开始也未必能想到带来了那么好的效果,起到了很好的作用。

对我们来说,去年 4 月我们发布 Magi-1 的时候,就开源了那个模型,子贺当时还在北欧读书,也是看到这个开源模型之后找到我们的。

极客公园:今天很多投资机构也是在 GitHub 上通过开源项目找创业者。所以视频模型这个赛道,今天发展到了什么阶段?

曹越:这件事已经进入了一个「节奏分化」的阶段:有些方向会先成熟,有些方向会更晚成熟。现在最明确已经成立的,是用视频模型来替代实拍。

过去如果要做一段内容,需要租场地、灯光、演员,再进入拍摄流程;现在则越来越多地变成「写好 prompt,点击生成」。这一能力首先服务的是一群本来就在做内容生产的专业创作者,帮助他们替代过去的实拍环节。

因此,现阶段最成熟的不是泛娱乐消费,而是有明确目标的内容生产。随着模型能力变强,这部分创作者使用 AI 的比例在持续提高,而且这类人本来就有生产需求、也更愿意付费。过去接近两年里,可灵、Runway、Seedance 的增长,都是建立在这类场景之上,典型应用包括短视频内容、广告电商、短剧等泛内容生产。

极客公园:中美对待视频模型的整体态度,有什么不同?

曹越:我认为,中美团队的差异实质上来自过去十年的产业和产品环境不同。

在北美,过去十年 C 端的大钱更多被 Meta 这样的巨头拿走,真正以 C 端产品为核心的创业公司相对少,因此大量创业公司更习惯在 ToB SaaS 上挣钱。

而过去十年,微信、短视频等产品形态是中国最热的产品,因此整个市场对 ToC 场景的感知更强。所以,在视频生成这件事上,中国公司会更重视它的价值,也更相信它能很快产生商业回报。

某种程度上,我理解 OpenAI 停掉 Sora,可以看成把更多算力资源倾斜到了 coding 这个方向。相较之下,中国公司看起来更重视视频生成,因为它已经是除 coding 之外最明确的大场景之一,而且商业价值也更容易被验证。

Sand.ai 创始人曹越,此前曾任光年之外联合创始人 | 图片由受访者提供

极客公园:具体到大公司和创业者,他们都做了什么?你有关注美国那边 Runway 最近的动作吗?

曹越:我们其实没有特别关注 Runway。因为看起来,他们在「面向创作者的纯视频生成」产品层面,似乎没有再进行特别大规模的投入,整体叙事越来越偏向「世界模型」,包括 Luma AI 也是这样的。相比继续强化产品,美国的创业者更聚焦在强化模型,以及模型继续演进的方向。

极客公园:所以他们是「弱化产品、强化模型」?

曹越:对,硅谷我认为是这个趋势。

在中国,产品则会更快地进入商业化阶段。以 Seedance、可灵为代表,中国的视频模型可以更快实现付费的闭环。不过,虽然在语言模型上,国内和国际最领先水平仍有 gap,但在视频这个方向上,我认为中国公司的模型能力已经处在世界第一梯队了,这也是它们更容易率先把商业场景打出来的原因。

Part.2:为数不多的技术共识:音画同出、多镜头叙事

极客公园:视频模型的技术路线,今天收敛了吗?

曹越:没有收敛。至少现在还没出现像语言模型里 coding 那样,所有人都必须死磕、不能落后的统一方向。

目前视频模型的竞争,更像是不同团队在不同方向上做强化选择。例如多镜头叙事这件事,目前 Seedance 是处于领先地位的,但我们认为这并不来自不可复制的绝对技术壁垒,更是「更早选择了这个方向,并更早把它做好」的判断,从而获得了大约三个月左右的领先周期。

其实,从过去两三年模型能力的进展看,一家公司做出的能力,其他公司往往会在很短时间内跟进,快则两三个月,慢则三到六个月。所以,竞争核心不完全是长期技术壁垒,也包括阶段性的判断和选择。

极客公园:那么过去一年,视频模型层面最关键的技术突破是什么?

曹越:我认为是音画同出和多镜头叙事。

Google Veo 3 是最早做出音画同出的模型之一,我们后来也很快跟进了。它的关键价值在于:人物的基础表演会变得更细腻、更逼真,尤其是口型、声音、动作之间的同步,会让人物看起来没那么像一个 AI 合成的人,而更像真实表演。

极客公园:那多镜头叙事呢?

曹越:多镜头叙事的重要性,其实更多是在它被做出来之后,行业内才突然意识到。因为它显著提升了叙事型视频的质量和真实感。

如果只是单镜头生成,即便画面本身很好,人依然会隐约觉得「不太对劲」。因为人天然生活在 3D 空间里,对空间是否真实有非常敏锐的感受。多镜头叙事能在一段短视频里,让同一个场景从不同视角被表现出来。比如先从一个角度拍一个人说话,再切到另一个角度拍另一个人回应。这样一来,观众会迅速建立起对这个场景的空间感,整体也就显得更真实、更舒服。

另外,现实世界里本来就存在大量天然对齐的信息。画面和声音是对齐的;同一个空间里的不同视角也是对齐的。过去如果模型只处理单镜头、无声音的内容,其实就等于没有利用这些现实中天然存在的信息。一旦把这些不同维度的信息一起灌进同一个模型里,生成效果就会显著提高。

极客公园:听起来是一个不断升维的过程,从静态画面,到动态画面加声音,再到同一空间内的多视角表达,能力是一层层往上叠加的。叠到某个临界点后,用户才会突然觉得「这个东西真能用了」。

曹越:这其实就是多模态的本质:把物理世界里原本已经对齐的信息,用同一个模型统一起来。

极客公园:视频模型领域,会不会出现一个类似 coding 之于语言模型那种「皇冠上的明珠」?如果会,它是什么?

曹越:如果现在就让我给一个已经完全收敛的答案,我觉得还没有。但我认为视频模型下一步非常关键的方向,很可能是更强的上下文理解、thinking,以及由此带来的更细腻的表演能力。

今天的模型已经能做到一部分事情。比如你给一张照片,再给一个比较具体的描述,它已经可以让这个人带着某种情绪去说一段台词,而且画面和声音是一起生成的,所以对齐度会比较高,你会觉得它比较真。

但这还只是比较粗的层面。如果想要更细腻地表达一段音画同出的内容,我觉得模型需要的不是更简单的一对一映射,而是 thinking。也就是它看到一整段 prompt 之后,不是直接把「愤怒地说」映射成一个表情,而是先理解上下文:这个角色是谁,之前发生了什么,这个场景是什么,他应该怎样表达。只有这样,表演才会更细腻,也更贴合场景。

现在,还没有模型能真正做到这一点,但我觉得这会来得很快,而且会是下一个非常关键的 breakthrough。

Part.3:从创作者到「视频投资人」

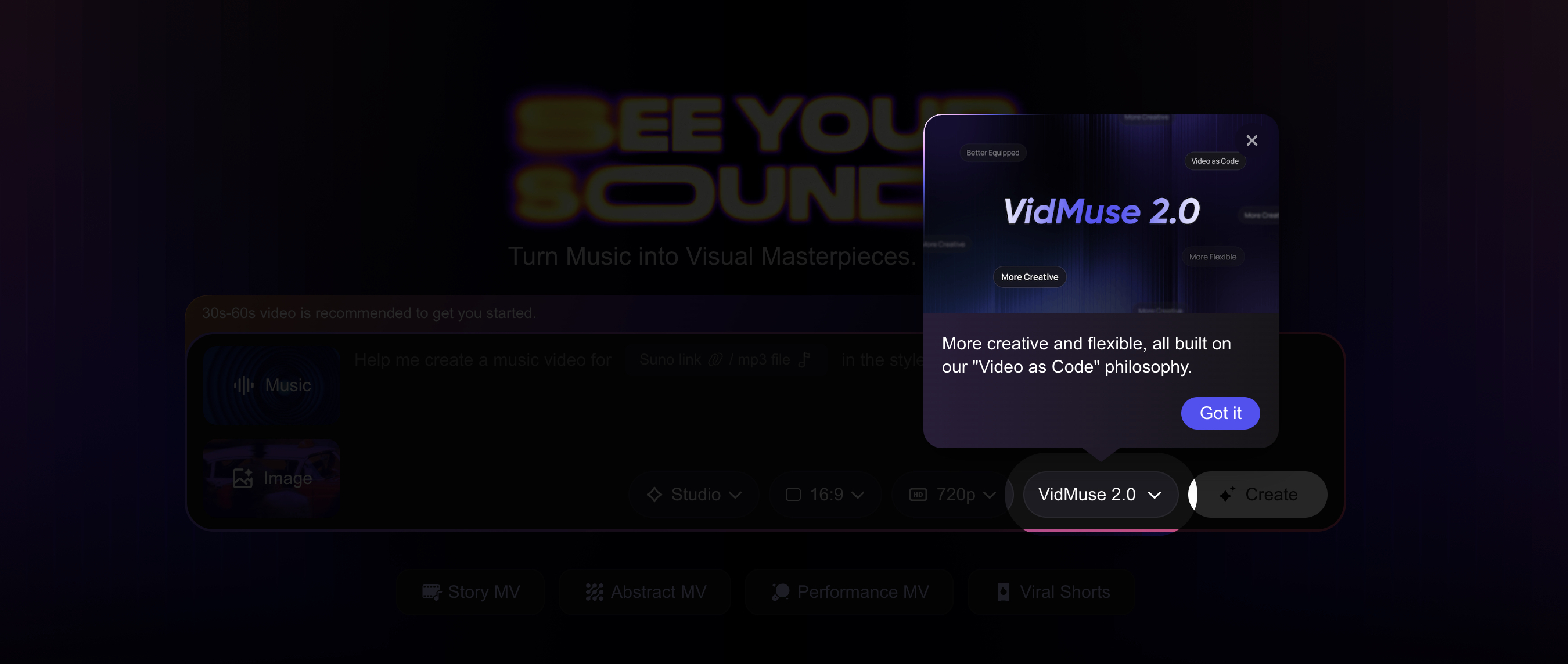

极客公园:聊聊你们在内测的新产品 VidMuse 2.0 吧。我看了你们的介绍,交互逻辑是「Music in,Video Out」,这次核心的升级是什么?

张子贺:VidMuse 2.0 的核心,不是多了几个功能,而是重新做了 agent 的框架。

之前市面上的很多 Video Agent,包括我们自己 1.0 的状态,都会更像一个「带着脚镣」的 agent:它只能按你预设好的 workflow,一步一步往下走。

但视频创作本身不是一个线性的流程,它是一个很发散的过程。所以 2.0 的核心升级,就是从这种 Workflow 式、强编排的工具,转向一个更开放的 Video Agent。我们想做的是,尽量把原来加在 AI 身上的那些手链、脚链放开,让它自己去发挥智能,顺着用户需求和创作过程流动。

极客公园:现在大家都开始放开缰绳、少编排,更多交给 agent 创造好环境,VidMuse 2.0 基本就是往这个思路走的,对吗?

张子贺:是的,因为视频创作这件事本身非常社区驱动。社区里会不断冒出新的玩法、新的创作习惯、新的表达方式。如果每次社区冒出一个新想法,如果我都要靠人力、物力再去迭代一个新功能,那这个产品是永远追不上的。哪怕有各类 coding agent 提效,你也不可能真的 24 小时在线去手工支持所有这些变化。

所以,从产品角度看,把 AI 绑在固定 workflow 里,是追不上创作演化速度的。

极客公园:既然你认为它是一个 Video Agent,那它对标的是什么?

张子贺:我们从一开始就不是把它当成一个单点工具,而是把它当成一个「完整的乙方」或者「制片团队」。我们看到很多 AI 时代的创作者,为了做一个完整视频,要在 DeepSeek、Midjourney、生图工具、生视频工具之间来回穿梭,自己搭管线,门槛很高。我们当时看到的机会就是:能不能在这些工具之上架一个 agent,把它变成一个完整的制片团队。用户不需要再自己穿梭在各种工具里,只需要说目标,agent 去组织流程、调度 agent,最后把视频交付出来。

极客公园:这个形态下,用户其实就成为了制片人或者投资方。「烧」Token,然后得到满意的成片。

张子贺:是的。

VidMuse 产品负责人张子贺Zake | 图片由受访者提供

Part.4:音乐是 AI 时代的视频创作起点

极客公园:我听说有人把 VidMuse 看成一个 MV 场景的垂类产品?你们肯定是奔着一个通用目标去的吧?

张子贺:我想专门澄清一下。我们内部从来没有说过自己只做 MV,也从来没有把自己定位成一个 MV Video Agent。

一开始我们也走过一些弯路。最初的想法是,模型能力本来是通用的,那产品也应该尽量通用,不要给模型太多预设。但真正做的时候你会发现,如果所有场景都想覆盖,产品很难跨过那个「用户愿意付费」的阈值,所以它必须收敛。

问题在于,怎么收敛。很多人会按内容类型去切:音乐、漫剧、广告,分别做成不同产品。但我不太认同这种切法。因为如果你按内容类型把产品框死,它后面一旦要辐射更多场景,往往就得重构。我们最后选择的不是按内容类型切,而是按创作链路去切。也就是说,我不是先定义「我做的是 MV」,而是先定义:AI 时代的视频创作,到底是沿着什么链路往前走的。

极客公园:所以你们是会顺着「创作意愿」去找用户?音乐为什么会成为更好的切入口?

张子贺:我越来越觉得,音频是一个比图片和文字更适合切入的连续信息。图片和文字更像是离散的,但音频,尤其是音乐,是连续流动的。

我们刷了很多 Twitter、YouTube 火的纯 AI 生成视频,发现它们有一个很明显的共性:很多作品其实都是通过音乐或者音频去 drive 整个创作链路。所以我当时才会说,音乐其实像这个视频的骨架。

所以我会觉得:AI 时代的视频,不一定还需要传统剪映式的软件逻辑,而更可能是沿着音频驱动的链路往前走。我们后来选择从音乐切,不是因为「MV 这个品类本身」,而是因为我觉得在音频里,音乐占了一个非常大的部分,它是最自然的入口。

极客公园:如果顺着这个逻辑往外延展?MV 之外还可能是什么?

张子贺:这套理解后来又延伸到广告。我觉得,广告里很多真正让人记住的东西,不只是画面和文案,还有旋律。一个词配上一段洗脑的音乐,再配上简单但强记忆点的画面,信息传递会被明显放大。

极客公园:所以从更长远的角度看,你们会认为「文字、画面、旋律」看成一种更高维的内容格式,而不是把音乐只当成一个附属元素。

张子贺:是的。

VidMuse 的产品界面

极客公园:选择「Music in」,跟用户画像有关系吗?

张子贺:有,而且关系很大。

我们有一个很明确的判断:很多 Video Agent 在增长上会遇到瓶颈,因为你很难凭空创造用户的「创作意愿」。一个人如果本来没有生产视频的意愿,你很难让他突然开始做这件事,ROI 也很难算正。但从音乐切就不一样。因为有音乐的人,天然已经有创作意愿,让他从音乐顺理成章地过渡到视频,投放和增长的 ROI 会更正,这也是我们增长比较快的一个原因。

所以,音乐不是随便选的流量入口,而是和「创作意愿」直接相关。

极客公园:你们现在的用户画像,大概是怎样的?

张子贺:我会把他们大致分成两类。

第一类就是音乐相关用户,不管是传统音乐人,还是 AI 音乐人。后者其实占了很大一部分——比如 Suno 赋予了他们创作能力,他们从原来只是音乐爱好者,慢慢成长到会频繁发布自己的歌,希望有更多人听到。

但光有音乐还不够。你把音乐发在 Spotify 或 SoundCloud 上,真正能听到的人还是有限;流量更大的地方是 TikTok、Instagram、YouTube。这样一来,他们就天然需要一个视频媒介。所以我看到的第一批核心用户,其实就是:他们很会做音乐,但不会做音乐视频。他们本来就在音乐这个模态里很专业,来到 VidMuse,是为了补上「从音乐到视频」这一步。

极客公园:那么另一类呢?

张子贺:我们内部把他们叫做泛生活化创作的人。

这类人的创作内容更偏生活和个人表达,比如年会视频、孩子成长、朋友生日、家庭纪念日,这些都算。这个方向本身就是一个新发现,因为过去这类人其实很容易被忽视。

更让我们印象深的是,里面还有一部分是非常强的个人情绪表达。有人会用它创作一些关于童年、家庭关系等等题材的视频。他们很多时候其实已经有一首自己的歌,然后用这个产品去把那首歌对应成自己心里真正想要的画面,一遍一遍调。这里面有些内容甚至不会发到任何平台上,它不是为了传播,而是为了表达和宣泄。

这类用户很重要的一点是:他们上传的往往是非常隐私的照片和故事。他们未必愿意把这些内容交给一个人类创作者,但愿意交给一个工具或 agent 去完成。所以我会觉得,这里已经不只是普通的内容生产,它更接近一种个人纪念、情绪整理,甚至某种自我疗愈式的创作。

Part.5:创业公司更容易搞定「双轮驱动」

极客公园:如果通过编排和加 skill 的方式,用 OpenClaw 做一个类似的产品,那你们自己的模型在 VidMuse 里到底扮演什么角色?你们的模型和产品之间,是强耦合还是弱耦合?

曹越:我们内部从一开始就是双轮驱动。

产品不应该被模型掣肘,产品的目标是服务用户、把规模做大,所以不应该带着镣铐跳舞,哪怕这个镣铐是金的。对我们来说,哪个模型能让产品跑得更快,就应该调用哪个模型;我们从一开始就没有要求产品必须用自家模型。

但换一个角度,模型团队在很多场景下又确实要支持产品。比如我们做 Music Video,第一步就需要更准确地分析音乐,识别节奏、卡点这些细颗粒度信息,这时候模型团队就可以过来支持,把音乐分析做得更准。再比如在视频生成里,有些场景用我们自己的模型效果更好,或者成本更低,这些也都能直接支持产品。

所以这不是简单的强耦合或者弱耦合。更准确地说,产品先按自己的节奏跑,模型在关键环节提供支持:一方面提升效果,另一方面降低调用 API 的成本,提高毛利,帮助产品跑得更大。

极客公园:双轮驱动肯定好,但也肯定难。

曹越:我的感受是,创业公司更容易把双轮驱动搞定。原因不是团队小本身,而是创业公司里更容易有一批真正处在 founder mode 的人。无论是做业务、做产品,还是做模型的人,只要他们心里的目标和公司的目标是对齐的,这件事就好推动。

反过来,如果一个做模型的人心里想的是「我要做一个特别的模型,公司好坏跟我关系不大」,那他的目标其实只对齐在模型这条线上,这就不是双轮驱动,而是单轮驱动。

所以真正决定双轮驱动能不能成立的,不是形式上公司里同时有模型和产品,而是两边负责人是不是都相信:同时拥有模型和产品,对公司整体是更有利的。

极客公园:具体来说,你们是怎么处理「先用最好模型把产品跑起来,再把关键能力收回来」这个问题的?

曹越:从产品 0 到 1 去找 PMF 的阶段,如果一开始就和自家模型绑得太死,验证周期会被拉长,不利于快速验证、快速找到 PMF。所以我们过去这段时间的做法是,先拿效果最好的模型把产品搭起来。

这个阶段我们不会先优先考虑成本,而是先看它能跑到什么状态,这个产物能不能交付,能不能形成商业闭环。等这条链路先跑通以后,我们再看有哪些地方值得优化、值得收回来。

所以这件事不是一开始就要求产品必须用自家模型,而是先让产品按自己的节奏跑起来;模型团队在关键环节提供支持。一方面把效果做得更好,另一方面把调用 API 的成本降下来,提高毛利,帮助产品跑得更大。

Part.6:信任关系才是最深的护城河

极客公园:你们现在商业收入跑到什么程度了?

张子贺:VidMuse 从 1 月中旬上线开始,大概两个月时间,跑到了 1000 万美金的 ARR,而且还在涨。基本上是单周 20 多万美金的收入,并且已经比较稳定。

收费方式上,我们现在是订阅+加油包。注册用户有免费 1000 积分,可以先起一个项目。

极客公园:1000 积分是什么概念?

张子贺:大概能把一个 30 秒左右的视频项目推进到比较后面的阶段。

极客公园:付费转化率、客单价怎么样?

张子贺:注册到付费的转化大约在 5%-7%。客单价一直比较高,因为用户需要先订阅,再买加油包,有些人最后会直接升级到更高阶版本。

极客公园:继续往后走呢?VidMuse 3.0、4.0 还要补齐什么能力?产品边界会怎么变?

曹越:3.0 或 4.0 应该是一个更彻底释放的状态:用户提一个原来产品里没有的功能,它也能想办法调动自己拥有的资源,把这个问题解决掉。

这件事会越来越依赖更通用的 agent 能力,尤其是 coding agent 的能力。因为社区里会不断冒出千奇百怪的需求。你得有一种能力,能顺着用户的需求流动,用户给你一个链接、一个帖子、一个教程,你能理解里面的方法,然后把它实现出来。产品会更少依赖预设功能,而是更顺着用户需求流动。

极客公园:听起来,未来的产品会越来越「无为」。从长期看,Sand.ai 的护城河是什么?怎么留住用户、沉淀长期价值?我相信不止是模型能力吧?

曹越:现在 AI agent 产品最大的问题之一,是稳定性很差,很难和用户建立可信赖的关系。

所以我们的思路是:先解决各种幻觉,尤其是多轮对话里小幻觉被不断放大的问题,让用户敢信你。我们希望用户在创作结束时,留下的是「thank you」、「good night」这样的情绪,而不是被激怒、被消耗。第一步先是建立信任感。

第二步,是让用户愿意留在这里。好的产品要在使用过程中不断认识这个人、了解这个人、理解他喜欢什么。比如用户已经明确说过自己喜欢诺兰,就不要再给他推别的导演风格;用户说过自己不喜欢紫色,后面的场景、分镜、脚本设计就不该再往这个方向走。

所以,memory(长期记忆)和信任关系是我们 Video Agent 的灵魂。